Ukens notater #37: Apples store uke

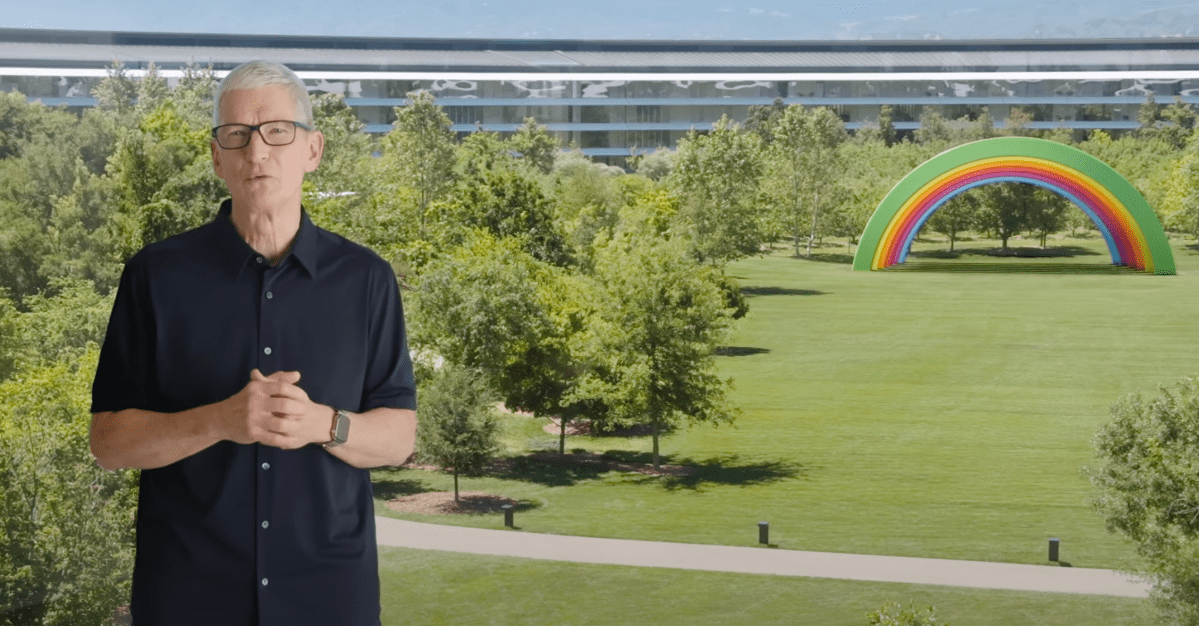

Mandag i uken som gikk holdt Apple sin årlige utviklerkonferanse WWDC i Cupertino. På forhånd var forventningene dratt kraftig ned etter fjorårets lansering av en smartere Siri som har blitt utsatt til 2026. Noen ny Siri ble ikke vist fram, men hovedfokuset på årets konferansen var et helt nytt designspråk - Liquid Glass.

Dette er ikke bare en UI-oppfriskning. Det er en gjennomgripende og ganske ambisiøs endring av hvordan programvare skal se ut og fungere på Apple-enheter i årene som kommer. Liquid Glass kombinerer elementer fra VisionOS med iOS, iPadOS og macOS.

Enkelt forklart kan man si at det er et gjennomsiktig, glassaktig design som etterligner de optiske egenskapene til ekte glass. Beveger du f.eks. telefonen eller iPaden vil du se at lyset i «glasset» reflekteres i takt med dine bevegelser. Glasset tilpasset seg innholdet og konteksten i sanntid ved å endre farger og lysstyrker. Dette er et veldig lekent, morsomt og gjør grensesnittet veldig levende, samtidig som det også innfører en del utfordringer.

Med Liquid Glass flytter Apple visjonen de har hatt for VisionOS over til alle Apples systemer. Uansett om du har en iPhone, iPad, Mac, Apple Watch eller Apple TV så får du nå et nytt grensesnitt. Dette lukter veldig langsiktig planlegging. Det er ikke veldig vanskelig å forestille seg at dette er designgrunnlaget for fremtidige Apple-briller som det ryktes at selskapet jobber med som videreutvikling av Vision Pro.

Som alltid med store designendringer, kommer det også umiddelbare motreaksjoner. De fleste mennesker hater forandring – i hvert fall i grensesnitt. Men kritikken av Liquid Glass handler ikke bare om uvant design og endringer. Det handler også om svak kontrast, rare skygger og andre valg som gjør Apples produkter mindre tilgjengelige for brukere med nedsatt syn og andre handikapp. En relativt dårlig utvikling. Alt dette er problemer som må løses før lansering i september og vi som har vært med en stund på disse lanseringene vet at mye skjer mellom juni og september. Dette er en utviklerversjon, ikke et ferdig produkt.

Likevel synes jeg det er noe friskt og modig her. Apple kunne valgt en trygg iterasjon. I stedet går de for et tydelig designsystem som bryter med mye av det man har gjort før. Det er absolutt ikke nøytralt. Det har en klar idé om hvordan fremtiden bør se ut. Kanskje måtte de også gjøre dette for å nullstille litt etter fjorårets Siri-flause. Kanskje er dette også en måte å skille seg enda tydeligere fra Android, Google og webapps. Apple skaper et grensesnitt som vanskelig kan tilfredsstilles gjennom en nettleser. Kontrasten på de fantastiske brukeropplevelsene man kan bygge native og web blir større.

Samtidig fikk iPad sin kanskje viktigste oppdatering på mange år. Med iPadOS 26 er iPaden oppgradert til å bli en virkelig utfordrer for Mac og PC. Nå kan du multitaske med flere vinduer oppe samtidig, du kan flytte vinduer der du vil ha dem og ikke minst har vi også fått en meny-linje i toppen samt en ordentlig musepeker. Det har tatt Apple mange år, men nå ser vi som elsker iPad lys i tunellen på å bruke den som et seriøst verktøy.

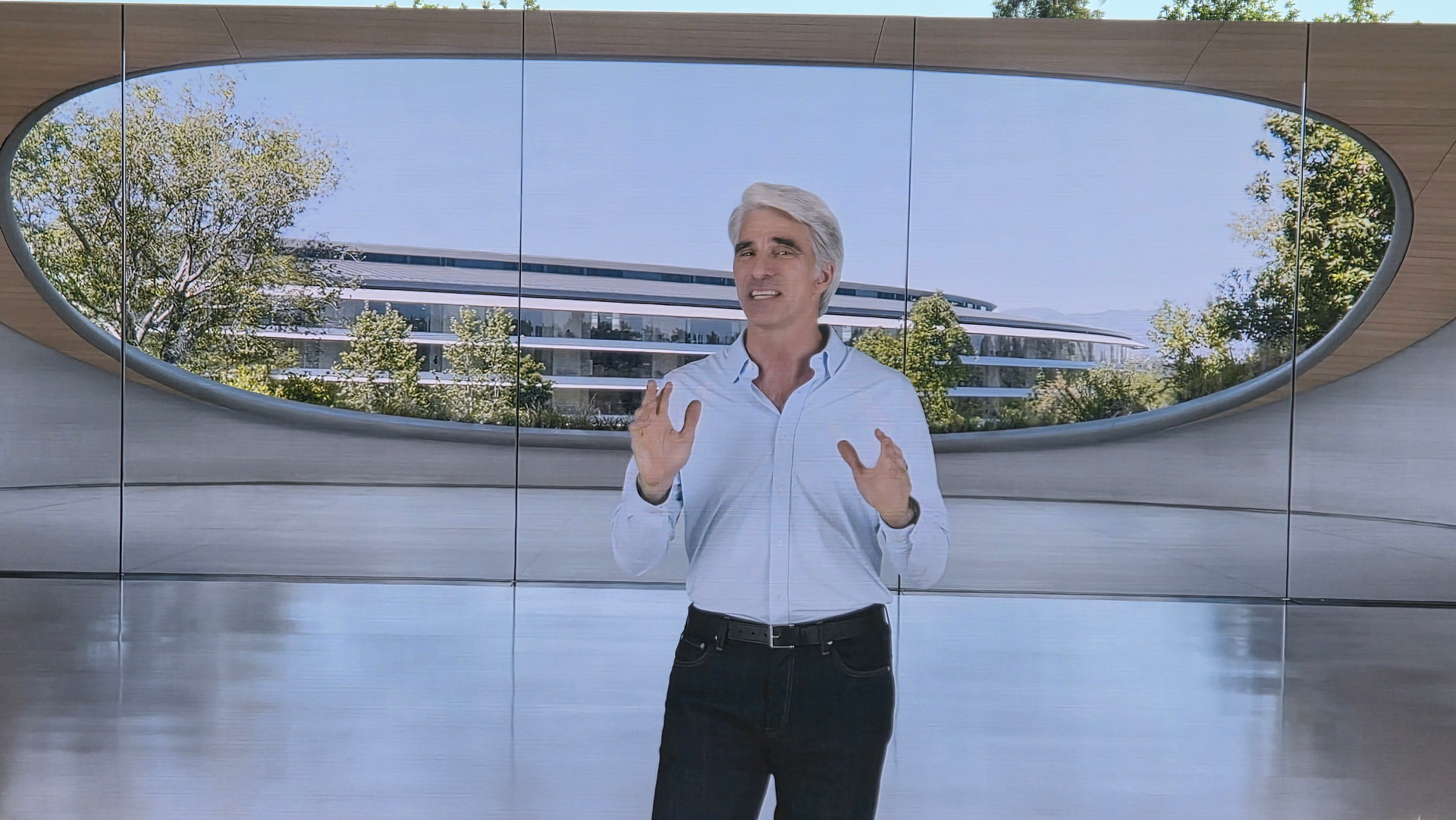

Og så var det Siri og AI. Apple snakket mye om AI, men en smartere Siri glimrer fortsatt med sitt fravær. De mest spennende AI-nyhetene fra Apple var i mine øyne muligheten for utviklere å nå kjører Apples egne LLMer lokalt på iPhone/iPad via «Foundational Model Framework». Dette er Apples kompakte språkmodell (LLM) med rundt 3 milliarder parametere, optimalisert for å kjøre direkte på Apple-enheter. Denne modellen kan utføre oppgaver som tekstforståelse, oppsummering, tekstforbedring, korte dialoger og generering av innhold lokalt på enheten, uten å sende data til skyen. Ifølge Apple er den på par med Googles Gemma3. Utviklere får tilgang til disse modellene for å bygge egne AI-funksjoner inn i sine apper uten å måtte betale OpenAI, Google eller andre. Det er svært godt nytt for utviklere.

Norge var forøvrig også godt representert i år. Kahoot! og deres bruk av Apples AI-modeller ble nevnt og Agens sitt Skate City: New York ble også vist fram. Ganske kult!

Apples WWDC 2025 kan oppsummeres slik: en stor designendring, en etterlengtet frigjøring av iPad, og begynnelsen på en AI-retning hvor Apple jobber videre med det de er gode på - kombinasjonen av hardware og software. Det er et Apple i endring, men med mer tålmodighet enn hastverk. Verken Liquid Glass eller AI kommer til å være perfekt i september, men kanskje er det heller ikke poenget. Apple tenker i tiår. Så er spørsmålet om Apples polerte lanseringer én gang i året er kompatibelt med suksess innen AI. AI utvikles kaotisk og kontinuerlig, ikke polert.

🤖 AI

- Den mest omdiskuterte utviklingen i AI i uka som gikk var Apples studie (jeg delte den i «Ukens notater #36») som avkler en av de største misforståelsene rundt språkmodeller: de tenker ikke. De hjelper. Antropomorfiseringen av AI, altså å tillegge den menneskelige egenskaper, har resultert i både hype og frykt, men også feilslåtte reguleringer og urealistiske forventninger. Steven Sinofsky skriver godt om dette i «The Illusion of Thinking" — Thoughts on This Important Paper» og minner oss igjen på at språkmodellene er verktøy, ikke mennesker.

- Benedict Evans skriver om «AI’s metric question» - hvordan skal vi måle vekst?

- Meta investerer 15 milliarder dollar for 49% av Scale AI og lager en ny intern «Superinteligence Lab» i Meta som skal ledes av Alexandr Wang, gründer av Scale AI. Scale AI er et av verdens ledende selskaper innen datainnsamling og -annotering av data for AI. Meta har hatt en veldig bra track-record på oppkjøp med Instagram, WhatsApp og Oculus.

- En follow-up på forrige ukes notat om bruk av droner i Ukraina så har Ukrainas sikkerhetstjenester nå bekreftet at de også brukte droner med AI-teknologi som autonomt kunne finne veien fram til målet.

- Dette var en nyhet jeg ikke så komme, men OpenAI har inngått en overraskende avtale med Google Cloud for å dekke sitt økende behov for compute. Dette er et tydelig skifte bort fra Microsofts eksklusive rolle. Det viser åpenbart også at infrastrukturen som er nødvendig for veksten til OpenAI er vanskelig å håndtere for enkelt selskaper. OpenAI leier nå kapasitet fra Microsoft, Oracle og Google.

- Googles AI-overview i søkeresultatene (hvor de gir svaret direkte) har allerede fått konsekvenser for mange nettsider. Business Insider rapporterer om en nedgang i organisk trafikk på 55%.

- Ukens AI-rettsak: Disney og NBC Universal saksøker Midjourney for brudd på opphavsrett. Dette er første sak hvor Hollywood studioer går etter AI-selskaper.

🌎 Big Tech

- Variety har et bra intervju med Tim Cook og Lewis Hamilton om Apples storsatsning på AppleTV+ filmen «F1». Det ser ut som Apple går «all in» på at denne filmen skal bli en suksess og har til og med laget en egen «haptic trailer» for iPhone. Se den på en iPhone for en interessant opplevelse.

- Google begynner utrullingen av Android 16. En vesentlig mindre oppdatering enn hva Apple presenterte under WWDC, men samtidig en del fine nye funksjoner - som f.eks. Googles variant av live updates.

🔎 Small Tech

- Telegram profilerer seg som en sikker og uavhengig meldingsapp, men det er mye som taler for at det hele er kontrollert av Russland. En ny granskning viser at sentral Telegram-infrastruktur kontrolleres av en russisk nettverksingeniør med nære bånd til FSB og militære etterretningstjenester. Bruk meldingstjenester med ordentlig ende-til-ende kryptering som Signal, iMessage eller WhatsApp. Relatert; Metas WhatsApp vil støtte Apple i deres rettsak mot britiske myndigheters krav om bakdør til ende-til-ende krypterte meldingstjenester.

- The Browser Company lanserer sin neste nettleser Dia i beta. Ser absolutt interessant ut.

- Elena Rossini gir en bra og forståelig gjennomgang av hva «the fediverse» er.

🌟 Annet

- Datatilsynet har nå gitt en av sine første bøter for brudd på innhenting av samtykke. 250 000,- i bot til Kristiansand kommune for å dele data med Snapchat og Meta uten at brukerne samtykket. Det blir mye mer av dette, spesielt når dagens samtykkesystem ikke er lovlig.

- Frankrike vil forby sosiale medier for de under 15 i løpet av få måneder hvis ikke dette blir gjort av EU selv. Jeg er ikke imot et forbud gitt problemene med en del sosiale medier, men spørsmålet er heller hva definerer vi som sosiale medier og hvordan skal dette i praksis gjennomføres? I «Ukens notater #13» diskuterte jeg litt av disse utfordringene.

📈 Interessante data

- Nintendo solgte 3.5 millioner Switch 2 på 2 dager. Ny salgsrekord for selskapet.